«Ne blocchiamo milioni al giorno», dicono ai media statunitensi i portavoce di Meta, l'azienda fondata da Mark Zuckerberg proprietaria di Facebook, Instagram, Messenger e WhatsApp. Eppure, sempre più utenti si lamentano e segnalano la presenza invasiva di bot ingannevoli.

I bot, in generale, sono degli account gestiti da software programmati per pubblicare, condividere e inviare messaggi di vario tipo. Simulando il comportamento umano. Molte aziende li usano, per esempio, per ampliare la propria community e attrarre nuovi potenziali clienti. Si stimano che almeno 95 milioni di utenti attivi, su Instagram, siano proprio dei bot (circa il 10% del totale).

Tra questi, però, ci sono i "bad bot", quelli cioè al servizio di malintenzionati, come li definisce la società di sicurezza informatica Impervia: sono account attivi nell'invio di messaggi spam, che spesso celano truffe e raggiri informatici ai danni degli altri utenti (cioé quelli usati da persone reali).

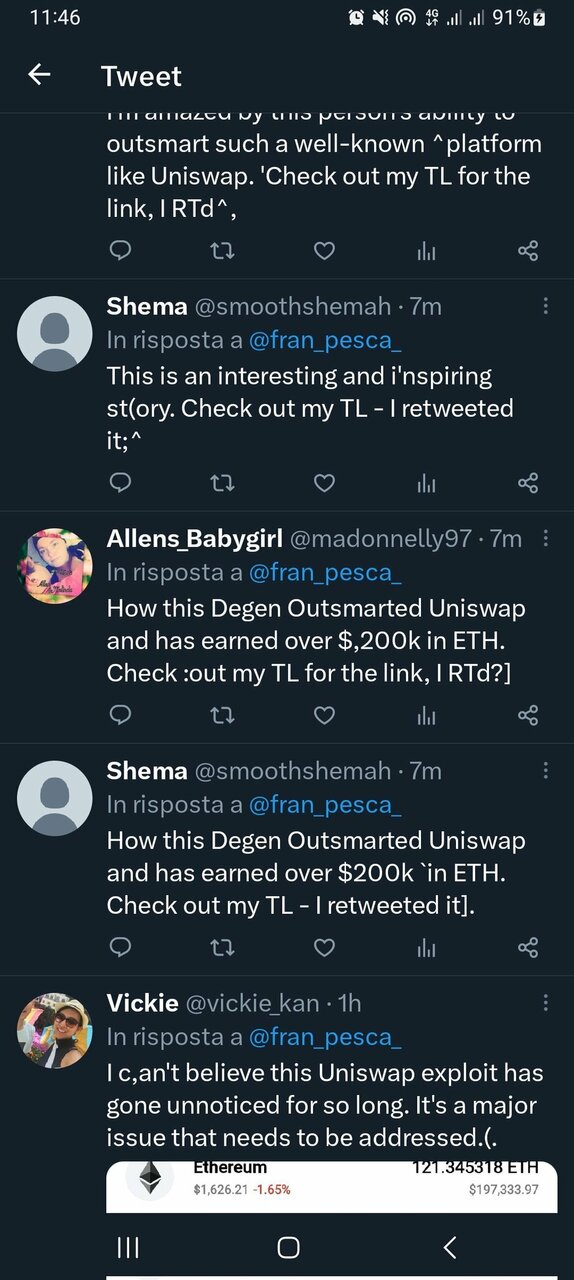

Tramite i bad bot, in sostanza, si cerca di spingere un utente a inviare soldi in cambio di "regali", accettare premi e offerte false, pagare per accedere a contenuti su OnlyFans, a registrarsi su siti porno, siti di gioco d'azzardo, siti di incontri online e via discorrendo. Altre volte si utilizza l'escamotage per indurlo a condividere i suoi dati bancari o a scaricare programmi contenenti virus o spyware.

Diventano via via sempre più intelligenti, i bot, nel simulare i comportamenti umani sui social: non solo chiedono di seguire l'utente e interagiscono con lui via chat, ma visualizzano anche le stories dei suoi followers e mettono like ai post. Tutto in maniera automatizzata.

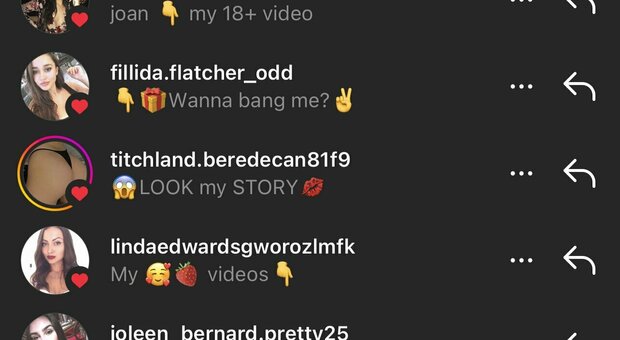

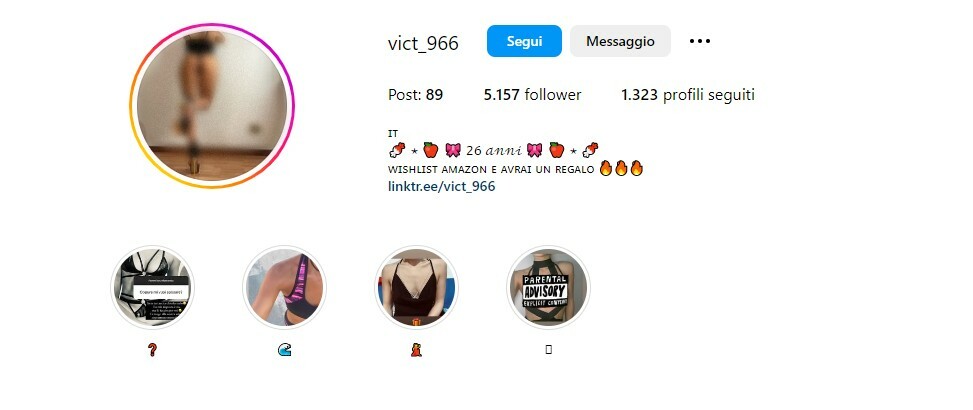

Una buona parte dei bot "ingannevoli", puntano proprio sull'appeal erotico: appaiono all'utente come ragazze disinibite (e poco vestite) per indurre l'utente a cliccare su siti ingannevoli e concludere astute operazioni di "phishing" ai suoi danni.

Si riconoscono, oltre che per le richieste immediate e poco verosimili, perlopiù per i nickname strampalati e i messaggi sessualmente espliciti nelle bio dei profili, corredati quasi sempre da un link esterno. Le foto esibite, invece, sono quasi sempre rubate da altri account.

Gli unici strumenti a disposizione degli utenti, per non cadere in trappola, sono la segnalazione e il blocco degli account di questo tipo. O quantomeno, ignorarli ed evitare di cliccare sui link che suggeriscono.

«Stiamo attualmente indagando su questo problema e abbiamo già rimosso una grande quantità di account per aver violato le nostre politiche sulle truffe», ha confermato uno dei portavoce di Meta a Cosmopolitan Uk. Attualmente Meta ha circa 15.000 moderatori attivi nella rimozione dei contenuti esplici, violenti o ingannevoli, come possono essere appunto i bot. A fronte però di 1,5 miliardi di utenti attivi al mese.

I tagli di Meta e Twitter sulla sicurezza

La stessa azienda californiana ha detto che presto aumenterà gli sforzi per rendere le piattaforme ancora più sicure, ma risulta difficile crederlo a fronte dei recenti cali dei profitti sugli utili trimestrali e del taglio complessivo di 21mila lavoratori, preannunciato da parte di Zuckemberg in due "tranche": una a novembre 2022 e l'altra a marzo 2023. Decisione che - secondo la Cnn - porterà a una riduzione totale del 25% della forza lavoro dell'azienda.

D'altro canto il patron di Twitter, Elon Musk, sta adottando politiche simili: a novembre, l'azienda ha licenziato circa la metà dei suoi dipendenti a contratto - dai 4400 ai 5500 lavoratori - e il team dedicato alla sicurezza ne sarebbe uscito ridotto del 15%: lo riporta la testata The Verge.

Anche il team di moderatori di contenuti di Meta, dislocato in tutto il mondo tramite aziende appaltatrici, ha subito di recente dei tagli. A gennaio la Sama, il principale partner addetto alla revisione dei contenuti di Meta in Africa, ha annunciato la chiusura del suo hub di moderatori. 200 dipendenti sono stati dunque rimandati a casa. 43 membri del team, lo scorso marzo, hanno poi citato in giudizio Meta e Sama per sfruttamento dei lavoratori.

Uno di loro, Daniele Motaung, ha raccontato al Time di condizioni di lavoro umilanti e misere. In particolare, si trascorrevano fino a 12 ore giornaliere davanti al pc, a eliminare contenuti riguardanti violenze di ogni tipo, tra cui decapitazioni e abusi sui minori. Il tutto in cambio di una paga oraria da 2 euro all'ora, senza nessuna forma di assistenza psicologica, nonostante molti moderatori iniziassero ad accusare sintomi da stress post-traumatico.